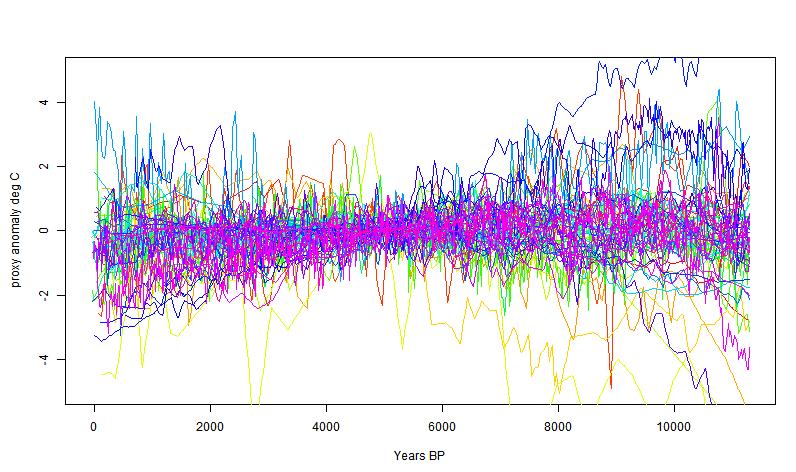

Mentre nel web climatico continua la polemica sulla ricostruzione in Marcott et al., 2013 (qui e qui su CM), grazie all’eco di uno starnazzo di global warming giunto sin qua sebbene attutito dalla neve che continua a cadere copiosa, veniamo a conoscenza di un lavoro interessante fatto da Nick Stokes, ossia un grafico interattivo che permette di visualizzare le curve dei proxy una per una nel contesto di tutte le altre, successivamente riadattato con l’opzione che permette di vedere l’effetto sulle singole curve delle operazioni di modifica della datazione di alcuni dei proxy oggetto come detto e letto di tanta discussione.

La prima impressione è quella che ogni curva vada decisamente per i fatti propri, mentre tutte le altre affollano lo spazio della spaghettata, nel senso che mentre una scende un’altra sale, un’altra resta piatta e così via. D’accordo, sono dati di prossimità da fonti e luoghi diversi, messi tutti insieme dovrebbero dare un’idea di quel che è successo. Per prossimità però si intende riconducibili all’informazione temperatura e quindi ad essa prossimi, non uguali. Per esserlo un po’ di più, data la loro intrinseca natura disomogenea, l’intervallo utile, ossia il periodo minimo per il quale sia possibile apprezzare variazioni, è stato tenuto piuttosto alto, 300 anni. La catastrofe climatica di cui si starnazza ogni dove è stata certificata dall’IPCC nelle ultime tre decadi del secolo scorso o giù di lì, cioè 1/10 del periodo suddetto.

Non è da Marcott et al. 2013 che sapremo se trattasi di AGW oppure no.

Anche perché loro alla fine del secolo scorso non ci sono arrivati. Sempre con il tool segnalato più su è possibile apprezzare quanto pochi siano i proxy con cui gli autori hanno “(ri)costruito” il balzo verso l’alto della fine del loro periodo di analisi, la metà del secolo scorso. Non c’è da stupirsi se loro stessi giudicano poco robusti i loro dati di fine serie, senza però togliersi lo sfizio di segnalare che tanto caldo quanto indicano i loro dati poco robusti non lo ha fatto quasi mai.

Non è da Marcott et al. 2013 che sapremo se sia il caso o meno di togliere quel quasi.

Credo che lo scopo principale di questa storia degli

spaghetti è quello di dimostrare che in nessun periodo passato,

qualsiasi serie proxy si consideri, vi è sato un aumento brusco

delle temperature come negli ultimi cento anni (o ultimi trenta del

secolo scorso, se vi fa più piacere). Secondo me, però, il problema

è un altro e riguarda la comparazione tra i dati proxy e i dati

attuali: gli “strumenti” di misura sono enormemente diversi ed il

grado di precisione è diverso per cui il confronto è improponibile.

In più la risoluzione dei dati proxy è paragonabile con quella

delle misure attuali? Secondo me no. In parole povere il discorso,

come impostato, è del tutto errato. Secondo il mio modestissimo (ed

insignificante) parere si dovrebbero utilizzare due registri

diversi: i dati di prossimità rappresentano il risultato di uno

“strumento di misura” molto particolare che ci consente di

determinare le temperature del passato con un certo grado di

precisione e con una certa risoluzione spaziale; i dati strumentali

moderni, invece, ci restituiscono le temperature a partire dal

1890. Confondere i due registri è una colossale presa in giro ed ha

scarso significato scientifico perché equivale a confrontare tra

loro dati non confrontabili (opinione personale 🙂 ). Per

concludere una piccola osservazione circa il “giocattolo” creato da

N. Stokes: ho provato a modificare le serie proxy estendendo allo

zero i dati delle serie interrotte in epoche remote. Si ottiene un

forte appiattimento dei dati, quasi delle rette, e l’appiattimento

è tanto maggiore quanto più le serie sono state interrotte in tempi

remoti: effettivamente una perdita di tempo colossale. Ciao,

Donato.

“Confondere i due registri è una colossale presa in giro ed

ha scarso significato scientifico perché equivale a confrontare tra

loro dati non confrontabili (opinione personale 🙂 ).”. Sono

d’accordo con te Donato, ma penso che qualche sistema di raccordo

vada trovato, per poter avere serie storiche abbastanza lunghe.

Poi, sul modo di raccordare si può discutere. Per ribadire il mio

accordo con te, dopo aver graficato tutti i dati di Marcott e aver

notato che mediare il tutto, soprattutto per coprire le parti

mancati di una serie con le altre, è un’operazione tanto assurda

quanto (credo) necessaria, ho iniziato a calcolare gli spettri Lomb

(e forse farò anche le wavelets) di tutte le serie, una per una per

capire se sono presenti frequenze comuni. Ciao. Franco

“dove è stata certificata dall’IPCC nelle ultime tre decadi del secolo scorso o …”

Carlo Colarieti scriveva l’altro giorno:

“Come noto il riscaldamento globale che interessa il nostro pianeta è iniziato attorno alla metà del 1800 (questo bisogna ricordarlo perché spesso lo si attribuisce erroneamente solo all’ultimo trentennio) ”

Ecco, io non ci capisco più niente. L’IPCC sostiene ancora che è faccenda della seconda metà del ‘900?

Fabrizio, il trend positivo di lungo periodo delle temperature medie superficiali è iniziato nella seconda metà dell’800, come dice giustamente Carlo, anche se questa localizzazione è un po’ suggestiva, perché coincide con l’inizio dell’era industriale. In realtà si dovrebbe prendere a riferimento il culmine della PEG, cioè ben prima, perché è da lì che il Pianeta ha iniziato a scaldarsi. Come sappiamo però in questo trend di lungo periodo ci sono state varie oscillazioni a frequenza più alta, come ad esempio quella che va dalla metà del secolo scorso alla fine degli anni ’70 in termini negativi, e quella culminata invece negli anni ’30 in termini positivi. Siccome queste dinamiche mal si sposano con la teoria CO2-centrica, perché il caldo di inizio secolo è arrivato con concentrazioni molto più basse delle attuali nonostante il trend positivo di medio periodo abbia avuto una pendenza molto accentuata, e il freddo degli anni ’70 è in correlazione negativa con il forcing presunto, nelle determinazioni dell’IPCC si stabilisce “solo” che il riscaldamento di fine del secolo scorso è attribuibile al forcing antropico, mentre per il resto si parla di variabilità naturale, aerosol e via discorrendo.

Ora è più chiaro?

gg

Sì, allora almeno su qualche aspetto c’ero. E’ corretto affermare che se l’IPCC dovesse accettare che il trend del riscaldamento va anticipato di qualche decennio, vista la caduta della correlazione con la crescita di CO2, cadrebbe tutto il castello di carta?

Fabrizio il trend non deve essere accettato, è l’unica cosa certa che abbiamo, fatta salva l’incertezza intrinseca della misura. Il problema è l’attribuzione e ancora nessuno lo ha risolto, specie alla luce della nuova fase di correlazione negativa che stiamo vedendo.

gg

Non ho davvero capito che cosa dovrebbe suggerire l’uso del tool di Stokes. In effetti, ha ragione GG, sembra che ogni curva vada per conto proprio. A che serve o a che dovrebbe servire? Lo chiedo senza ironia. Semmai sembrerebbe un tool per dimostrare quanto poco compatibili tra loro siano i proxy. Ecco, se fosse questo lo scopo, avrebbe un senso. Altrimenti, cortesemente, qualcuno me lo spieghi.