In un recente post G. Guidi ha segnalato un interessante articolo, pubblicato su Nature Climate Change. in cui C. Hedemann, T. Mauritsen, J. Jungclaus e J. Marotzke (da ora in avanti Hedemann et al., 2017) analizzano una possibile spiegazione della pausa nel riscaldamento del clima terrestre, verificatasi nel corso della prima decade del 21° secolo.

The subtle origins of surface-warming hiatuses

Giusto per ricordarlo a me stesso, la pausa o iato è stato un fenomeno piuttosto controverso che ha agitato le acque della climatologia nel corso degli ultimi anni: il trend di aumento delle temperature superficiali terrestri è diminuito rispetto agli anni precedenti per cui sembrava scricchiolare il principale assunto dell’AGW: maggiore concentrazione di diossido di carbonio atmosferico => maggiore aumento delle temperature superficiali terrestri.

La pausa è stata riconosciuta come un fatto reale da molti ricercatori e, in modo alquanto sfumato, anche da IPCC che ha rivisto al ribasso i valori della Sensibilità Climatica all’Equilibrio; mentre molti altri ricercatori non hanno mai riconosciuto l’esistenza della pausa anzi ne hanno negato l’esistenza come nel caso di Karl et al., 2015. Le spiegazioni del fenomeno sono state molte, ma nessuna soddisfacente per cui, ad un certo punto, i ricercatori sembrava che avessero deciso di dedicarsi ad altro. Ciò anche in considerazione del fatto che con il forte El-Nino 2015 la pausa poteva considerarsi un fatto superato. Mi è parso strano, quindi, che un nuovo lavoro scientifico sull’argomento venisse pubblicato in questi giorni, per cui ho cercato di approfondire l’argomento, scoprendo molte cose interessanti (almeno per me, ovviamente).

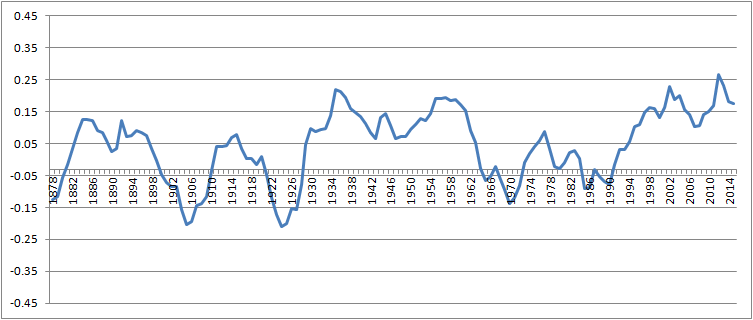

Hedemann et al., 2017 non è liberamente accessibile, per cui ho potuto leggere solo l’abstract, i materiali supplementari, studiare i grafici di cui alle figure 1, 2 e 3 dell’articolo ed il commento sul sito del Max Plank Institut fur Meteorologie cui l’autore principale è associato. Molto interessante mi è parso il grafico di fig. 1 in quanto riassume in modo estremamente efficace l’andamento del trend di variazione della temperatura terrestre calcolato su un intervallo temporale standard di 15 anni. In altri termini il grafico rappresenta “l’accelerazione” delle anomalie termiche. Nel seguito riporto il grafico tratto dalla figura 1 di Hedemann et al., 2017 (qui la fonte).

E’ un grafico piuttosto complesso che richiede più di qualche parola per essere descritto in modo comprensibile. Il grafico rappresenta il trend delle Temperature Medie Superficiali Terrestri (GMST) espresso in gradi centigradi per decade nel corso degli anni. Esso è stato ottenuto come ensemble di 100 termini del modello matematico accoppiato oceano-atmosfera MPI-ESM1.1. La parte fino al 2000 è stata forzata in base all’andamento delle temperature reali, quella successiva ipotizzando le condizioni previste dallo scenario di emissioni RCP 4.5 (lo scenario prevede una riduzione delle emissioni rispetto a quelle attuali). Le zone colorate del grafico sono rappresentative del numero di membri dell’ensemble (più scuro maggior numero di membri, più chiaro, minor numero di membri). La curva in grigio rappresenta il membro minimo dell’ensemble, mentre quella blu rappresenta la media dell’ensemble e, quindi, la temperatura attesa nel corso degli anni compresi tra il 1850 ed il 2015.

La curva rossa rappresenta la “definizione di iato” o di pausa che dir si voglia ed è stata costruita mediante una traslazione della curva blu verso il basso di un vettore, con direzione verticale, il cui modulo è pari alla differenza tra il valore del trend misurato nel periodo 1998-2012 (croce gialla) e quello previsto dai modelli (croce nera) sempre nello stesso periodo. In tal modo si è definita una curva formata dai punti che, potenzialmente, individuano uno iato uguale a quello verificatosi nella prima decade del 21° secolo. Il valore della differenza tra il trend rappresentato dalla croce nera e quello rappresentato dalla croce gialla, è pari a 0,17°C per decade. Conoscere questo dato non è importante per capire il ragionamento degli autori, ma rappresenta un utile completamento del discorso, in quanto consente di avere un’idea della differenza tra quello che prevedono i modelli e quello che accade in realtà. E’ solo un inciso, ma credo che esso sia importante in un discorso più generale sulle performance dei modelli matematici e della climatologia in genere.

Gli autori definiscono pausa o iato un periodo durante il quale il membro minimo dell’ensemble si posiziona al di sotto della curva rossa. Questo significa che il trend delle temperature decadali è inferiore di 0,17°C per decade rispetto a quanto atteso e, quindi, ci troviamo di fronte ad uno iato maggiore o uguale a quello sperimentato dopo il 2000. Sulla base di quanto sono riuscito a capire dai documenti, tra il 1850 ed i giorni nostri sono stati sperimentati ben 364 periodi in cui la tendenza delle variazioni delle temperature medie superficiali è stata uguale o inferiore a quella dell’ultima pausa cioè -0,17°C per decade.

Hedemann et al., 2017 considera due possibili spiegazioni per la pausa: un maggior riscaldamento degli oceani o un maggior flusso di calore che esca dall’atmosfera. Del resto se consideriamo il sistema climatico come una macchina termica e la temperatura superficiale una variabile che ne quantifica lo stato, la variazione della temperatura media superficiale può essere dovuta, stante la costanza del flusso di energia in entrata, o ad una variazione del contenuto di calore oceanico, oppure ad una variazione dell’energia emessa dal sistema attraverso la sua frontiera atmosferica che poi altro non è che il TOA. Ovviamente la causa potrebbe benissimo essere una combinazione di entrambe.

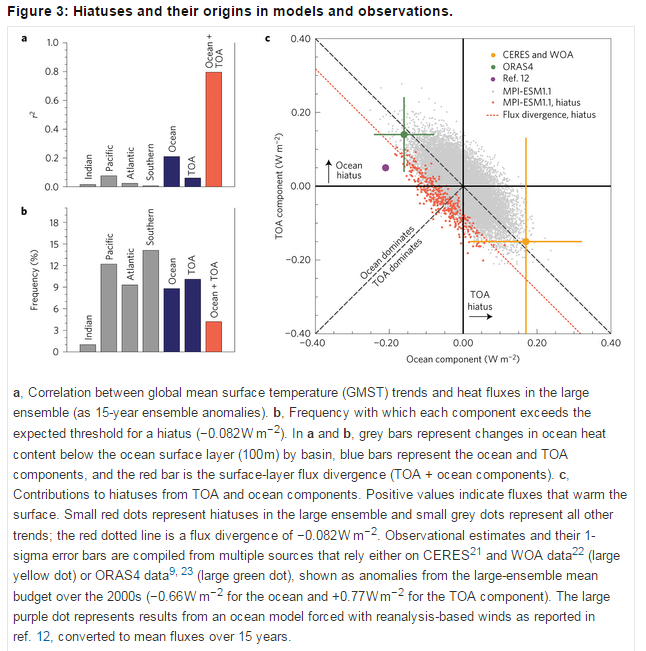

La fig.3 dell’articolo è fortemente esplicativa di quanto ho fin qui esposto e di quanto scriverò in seguito. Se consideriamo i flussi di calore da e verso l’oceano e quelli in uscita dal TOA, possiamo valutare l’anomalia tra quanto ci aspettiamo sulla base dei modelli e quanto misuriamo. Hedemann et al., 2017 hanno calcolato tanto le anomalie del contenuto di calore oceanico che quelle radiative al TOA ed hanno costruito un diagramma in cui hanno rappresentato il contributo allo iato della variazione del contenuto di calore oceanico e quello dello sbilanciamento radiativo al TOA. Il calcolo delle anomalie è esemplificato a pagina 2 (fig. 1) dei materiali supplementari e nelle pagine successive viene illustrato il complesso processo statistico con cui vengono quantificati i contributi dello squilibrio radiativo al TOA e delle variazioni del contenuto di calore degli oceani ai vari periodi di pausa individuati dagli autori dello studio.

Analizziamo la figura 3 di Hedemann et al., 2017. Notiamo che per tutti i periodi di pausa confrontabili con quello del 21° secolo, abbiamo avuto sia un contributo radiativo che di variazione del contenuto di calore oceanico. Gli autori hanno potuto calcolare che oltre il 70% dei periodi di pausa è stato determinato esclusivamente o con un sostanziale contributo dallo squilibrio radiativo al TOA. Altro aspetto degno di rilievo è che le pause sono determinate, contrariamente a quanto si pensava, da piccolissime variazioni nel flusso di calore dall’oceano all’atmosfera o dall’atmosfera allo spazio. La cosa è di fondamentale importanza in quanto le tecniche di misura dello squilibrio radiativo al TOA e del flusso di calore dall’oceano all’atmosfera NON consentono di misurare tali flussi di energia con sufficiente precisione, quindi, allo stato attuale dell’arte, siamo del tutto incapaci di stabilire la causa delle pause nel trend delle variazioni delle temperature superficiali medie globali. L’entità delle divergenze di flusso in grado di determinare le pause, sono, infine, talmente piccole da rientrare nella variabilità naturale del sistema. E con questo Hedemann et al., 2015 hanno assestato un bel colpo a chi crede che gli esseri umani abbiano completamente capito come funziona il sistema climatico terrestre e che restano da definire solo i dettagli.

Voglio, ora, svolgere alcune considerazioni che esulano un poco dal focus della ricerca di Hedemann e colleghi.

Credo che si sia capito che il lavoro commentato è basato quasi esclusivamente su elaborazioni di dati desunti da modelli matematici e di rianalisi, per cui ci troviamo di fronte a quelli che si chiamano “dati sisntetici”. Se ipotizziamo, però, che i modelli sono in grado di simulare il clima che cambia (come del resto fanno da decenni i ricercatori ed i decisori politici), possiamo fare alcune considerazioni circa le tendenze delle variazioni decadali delle temperature terrestri medie globali.

Tutte le considerazioni che seguono sono fatte con riferimento alla curva rossa che rappresenta “la definizione di iato”, ma valgono anche per la curva blu a meno di una semplice traslazione di 0,17°C per decade.

Guardando il grafico si nota come, a partire dal 1850, la tendenza della variazione delle temperature medie superficiali (da ora in poi deltaT per semplicità) vari in modo piuttosto bizzarro nel tempo.

- Dal 1850 al 1860 (circa) deltaT è cresciuto in maniera costante. Nel ventennio successivo deltaT è diminuito in modo non costante: ad una prima riduzione graduale ha fatto seguito una variazione repentina del trend che da -0,05°C per decade è passato a -0,35°C per decade.

- Dalla metà degli anni settanta del 1800 il deltaT è cresciuto costantemente passando da -0,35°C per decade a +0,05°C per decade: un riscaldamento globale ruggente con i fiocchi.

- In una decina d’anni il deltaT è tornato a diminuire oscillando tra circa -0,15° C per decade e -0,05°C per decade. Questo fino agli anni ’50 del secolo scorso, quando il deltaT ha cominciato a registrare un’altra serie di brusche oscillazioni. In un decennio (1945-1955) il deltaT è passato da -0,15° C per decade a -0,20°C per decade. Nel decennio successivo il deltaT è cresciuto fino ad arrivare allo zero e, tra alti e bassi, esso ha oscillato intorno a -0,05°C per decade fino alla fine degli anni ottanta del 20° secolo.

- In quegli anni il trend ha iniziato a salire raggiungendo il picco di 0,20°C per decade intorno al 1990. Dopo il 1990 il deltaT è diminuito fino ad azzerarsi intorno al 2000. Detto in altri termini le temperature globali sono sempre cambiate e con tassi di variazione sempre diversi l’uno dall’altro.

Di fronte ad un grafico del genere si fa molta fatica ad imputare le variazioni del trend decadale di variazione delle temperature alla sola CO2, in quanto la sua concentrazione atmosferica è aumentata in modo monotono durante tutta l’era industriale, per cui appare logico tener conto di una variabilità interna al sistema che genera queste oscillazioni.

Questo grafico, per quel che mi riguarda, è una pietra tombale sull’ipotesi che il sistema sia guidato solo ed esclusivamente dalla CO2 in quanto DEVE esistere una variabilità interna al sistema di cui, oggi come oggi, non si tiene conto o la si considera del tutto secondaria rispetto al ruolo delle cause antropiche. Detto in altri termini resta grande come un macigno il quesito: quanta parte dell’ultimo riscaldamento è imputabile all’uomo e quanta parte alla variabilità interna al sistema? Evitare di rispondere a questo quesito, sulla scorta di posizioni ideologiche è negare la scienza. La scienza non pensa, infatti, fa ipotesi da sottoporre a verifica sperimentale. Ed il lavoro di Hedemann et al., 2017 va in questa direzione.

Caro Donato,

leggendo il tuo interessante scritto ho iniziato a ragionare domandandomi perché gli autori abbiano sviluppato il loro ragionamento partendo da modelli e non da dati osservativi ma poi ho capito che con i modelli è possibile indagare anche il flusso di calore attraverso la superficie degli oceani e attraverso il TOA, per i quali non abbiamo dati osservativi se non per gli ultimi decenni.

In ogni caso ho provato a fare un’operazione analoga a quella con cui gli autori hanno ottenuto la figura 1 utilizzando i dati di anomalia termica globale di Hadcrut4 e i risultati sono nella figura allegata.

Rispetto alla figura ottenuta con i modelli vi sono varie similitudini e tuttavia vi sono alcune differenze rimarchevoli ed in particolare il fatto che i picchi positivi del 1885, del 1965 e del 1990 sono nettamente sovrastimati dai modelli (in particolare sottolineo che nel 1965 i dati osservativi non mostrano alcun picco positivo).

Il plateau fra 1900 a 1950 è invece reso in modo realistico.

Tutto ciò deve portarci a riflettere sulle limitazioni tuttora esistenti nei modelli e che si manifestano in periodi con livelli di CO2 molto diversi fra loro (1885, 1965, 1990). Evidentemente questo costituisce un elemento di debolezza dell’approccio modellistico con cui ci si dovrebbe confrontare in modo laico.

Rilevo infine che nel diagramma ricavato dai modelli i periodi 1850-1900 e 1950-2000 presentano un forma pressoché uguale. Caso o necessità?

Ciao.

Luigi

Immagine allegata

Caro Luigi, partiamo dalla coda!

“Caso o necessità?”

Non ne ho la più pallida idea, ma opto per il caso. 🙂

A meno che non vogliamo introdurre qualche periodicità nascosta nel rumore di fondo. F. Zavatti ha trovato molte periodicità nei dati grezzi che poi si perdono in quelli omogeneizzati: vuoi vedere che i modelli restituiscono dati più realistici di quelli omogeneizzati o addirittura reali? 🙂

.

In merito alla prima parte del tuo commento, concordo anche se non mi sento di escludere il margine di incertezza molto ampio delle misure disponibili (punti giallo e verde di fig. 3 con le relative barre di incertezza).

Se avessimo utilizzato le misure credo che sarebbe stato difficile intercettare le modeste variazioni nel trend di variazione delle temperature. Sarebbe stato difficile se non impossibile, inoltre, definire la curva delle pause.

Ciao, Donato.

La fonte si trova sul suo libro scritto insieme al suo collaboratore N.C.Wickcramasinghe: “Evoluzione dallo spazio”, che lessi tanti anni fa. Sinceramente ora non ti so dire la pagina dov’è perché dovrei cercarla. Il cosmologo che tu citi probabilmente la riprese da Hoyle in quanto anche questi non era d’accordo sul Big-Bang. Ora i dubbi cosmologici sul Big-Bang sono perlopiù superati e io sono convinto della validità del modello, però attualmente il modello del Big-Bang in qualche modo soddisfa la ragione principale che induceva Hoyle a criticarlo. Oggi si teorizza di un multiverso nel quale il Bang fu solo uno dei tanti episodi. Hoyle era per l’Universo stazionario e oggi il modello teorico che si sta imponendo è quello di un multiverso stazionario. Ciao.

Molto illuminante, grazie Virgilio.

Però alla fin fine si torna al punto: il modello AGW non risulta confermato dai fatti precisi in esso previsti ma resta valido lo stesso per causa di questo quello o quell’altro… In genere in altri ambiti scientifici quando osservazioni discordano dalle previsioni che da relativi modelli derivano significa che questi almeno in parte son sbagliati e dunque, almeno in parte, dev’esser scorretto l’assunto su cui vennero fondati. Invece qui si escogita sempre qualche scusa e ulteriori ipotesi per giustificare il modello. Fred Hoyle scriveva “diffidate d’una teoria che per sostenersi ha bisogno di continue nuove ipotesi…”

Grazie per la segnalazione di Fred Hoyle ma non sono riuscito a trovarne la fonte (graeie di indicare un link se esiste). Ho trovato una frase simile attribuita al cosmologo altenativo canadese Louis Marmet (che non accetta la teoria del Big Bang):

“The continuous addition of new hypotheses to a theory constantly in disagreement with observations is a strong indication that the underlying assumption, the Big Bang, is invalid” (http://www.cellularuniverse.org/MysteriesParadoxes.htm)

Non è ne tempo né clima ma credo sia utile pedagogia (che questo sito fa ogni giorno).

Caro Donato,

post che chiarisce molto bene il lavoro di Hedemann et al., 2017 e la sua importanza generale: il fatto che la temperatura globale media abbia subito nel tempo variazioni continue del trend ci dice che “il diavolo” CO2 ha poco a che fare con l’aumento delle temperature.

Come hai sottolineato, l’importanza dell’articolo è stata quella di aver verificato che è sufficiente una piccola variazione di flusso di calore dagli oceani o alla sommità dell’atmosfera per cambiare drasticamente la situazione delle temperature globali.

E’ chiaro che l’uso di dati sintetici non ci piace moltissimo, ma la cosa importante è lo studio delle loro variazioni nel tempo, in rapporto alle due grandezze prese in esame: questo rapporto potrebbe essere molto simile a quanto avverrebbe con i dati reali (affetti da errori troppo grandi per il tipo di analisi quì presentata).

Un lettore su un altro blog ha fornito un link al full text dell’articolo. Eccolo:

https://dl.dropboxusercontent.com/u/75831381/Hedemann%202017.pdf

Ciao. Franco

Caro Franco, ti ringrazio per il link al testo completo dell’articolo. Dopo aver letto la lettera diverse cose mi sono risultate più chiare e molte mie intuizioni sono state confermate. Non mi era molto chiaro, per esempio, il modo in cui gli autori avevano individuato i 364 periodi di pausa, né il motivo per cui avevano concentrato la loro attenzione solo sui primi 100 metri di profondità nel calcolo del flusso di calore dal mare verso l’atmosfera, ma ora le mie idee sono più chiare. Potrebbero sembrare dettagli, ma è nei dettagli che si annida il diavolo! 🙂

Ciao, Donato.