Questo è il terzo post che dedichiamo al paper di Marcott et al., ossia al recente studio pubblicato su Science in cui è stato ricostruito l’andamento della temperatura media del Pianeta degli ultimi 11.300 anni fermandosi alla metà del secolo scorso (qui e qui un po’ di precedenti).

Un paper che ha avuto molto risalto sui media suscitando al contempo un’accesa discussione sui blog che si occupano di scienza del clima. L’attenzione del mondo della comunicazione, anche e soprattutto della sua componente generalista, è stato innescato dal comunicato stampa della NSF (National Science Foundation), l’istituzione scientifica che lo ha finanziato, in cui se magnificavano i risultati, con il placet e l’imbeccata degli stessi autori, sottolineando come per la prima volta sia stato possibile far emergere la “particolarità” del trend positivo che le temperature hanno assunto nel secolo scorso. In particolare il messaggio espresso a chiare note era il seguente: dati il segno chiaramente negativo nella prima decade del secolo scorso e quello altrettanto chiaramente positivo della prima decade di questo secolo, nel contesto di un trend di generale diminuzione delle temperature che avrebbe caratterizzato gran parte dell’Olocene, siamo passati dalla decade più fredda a quella più calda degli ultimi 11.300 anni nell’arco di pochi decenni.

Ora, si dice in giro tra quelli che dicono di capirne qualcosa di clima che una decade non possa essere considerata in alcun modo rappresentativa in termini climatici. Personalmente non sono completamente d’accordo con questa affermazione, ma per ora lasciamo perdere questo aspetto e concentriamoci piuttosto sul paper in questione e su quello che ne è seguito. Secondo voi, uno studio su dati di prossimità che impedisce di valutare qualunque oscillazione della temperatura che abbia persistito per meno di 300 anni, può essere impiegato per valutazioni su singole decadi? La risposta è certamente no, ma questo, nessuno dei magnificatori sembra esserselo chiesto. E non se lo sono chiesto neanche gli autori, che in seguito ai numerosi problemi che la discussione sul paper ha sollevato, hanno pubblicato un documento in forma di FAQ, che non chiarisce affatto i punti chiave delle critiche sollevate, ma contiene una frase particolarmente significativa.

. . . the 20th century portion of our paleotemperature stack is not statistically robust, cannot be considered representative of global temperature changes . . .

Tutto chiaro? “La parte relativa ai tempi moderni della ricostruzione in Marcott et al., non è statisticamente solida, non può essere considerata rappresentativa di cambiamenti a livello globale delle temperature e su questa non si fonda alcuna delle conclusioni dello studio”. Punto primo, se non hanno alcuna robustezza statistica, che diavolo ci fanno i dati relativi all’era moderna nello studio? E come hanno passato il referaggio su Science? Punto secondo, come mai l’NSF ne ha parlato nel comunicato stampa con tanto di virgolettato di uno degli autori?

Siamo alle solite. Una ricerca, solida o debole, interessante o banale, non importa come sia, l’importante è che possa in qualche modo sostenere la causa dell’AGW, nella fattispecie facendo anche risorgere dalle ceneri in cui è giustamente finita una delle pagine più brutte della ricerca scientifica degli ultimi anni, l’Hockey Stick di Michael Mann, con il sostegno compatto delle truppe di Real Climate, il blog delle vestali del clima che ospitano il documento di risposta senza fare alcun cenno alle critiche sollevate.

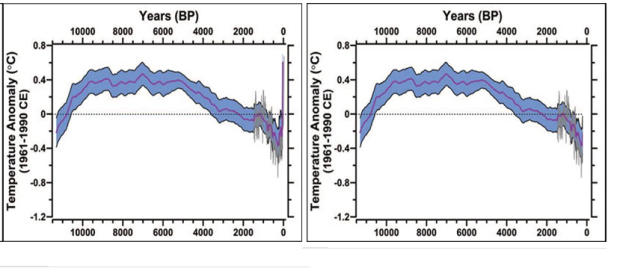

E così, Roger Pielke Jr, che non è scettico, ma non è neanche una vestale, ci va giù insolitamente duro adombrando il dubbio di “scientific misconduct“, ossia di comportamento anti-scientifico, soprattutto per il coinvolgimento di una autorità scientifica di peso come l’NSF, per l’atteggiamento degli autori e per la leggerezza con cui tutto questo è passato indenne tra le maglie di Science. Arriva al punto di chiedere che il paper sia ritirato e corretto, che sia espressa chiaramente la debolezza scientifica dei dati relativi al periodo recente, e che questi siano eliminati da tutte le figure pubblicate. In testa a questo post, c’è l’immagine di questo paper che ha avuto più successo, con e senza e dati relativi all’era moderna: quant attenzione avrebbe ricevuto se i dati relativi all’era moderna fossero stati omessi?

Insomma, come era chiaro sin dall’inizio, il documento che avrebbe dovuto chiarire i dubbi sul paper ne ha rivelato definitivamente la debolezza, con il placet dei duri e puri di Real Climate, che Pielke, in un commento al suo post definisce così:

There are a few bad eggs, with the Real Climate mafia being among them, who are exploiting climate science for personal and political gain.

Ci sono alcune uova marce, con la mafia di Real Climate tra loro, che stanno sfruttando la scienza del clima per scopi politici e personali. E questo ennesimo di scienza a colpi di comunicati stampa, di procedure impiegate non esplicitate, di risultati che richiamano l’attenzione dei media salvo rivelarsi nient’altro che la solita forma di lasciapassare per ottenere la ribalta e il plauso di attivisti travestiti da scienziati, che di giorno sono nel Working Group I dell’IPCC a scrivere le scientifical basis dei report e di notte scrivono risibili post in difesa di lavori indifendibili, è lo stato dell’arte della scienza del clima. Ma l’inevitabile perdita di credibilità di questi signori che, statene pure certi, quando il castello di carta dell’AGW sarà del tutto indifendibile troveranno il modo di uscirsene con un “ve l’avevamo detto”, non il solo danno che stanno producendo. Torniamo al commento di Roger Pielke jr:

[…] virtually all of the climate science battles are teapot/tempest affairs — climate politics and policy has moved on to issues involving economics and energy.

Virtualmente, tutte le battaglie sulla scienza del clima sono tempeste in una tazza di te’ — le policy e le politiche del clima si sono spostate su argomenti che riguardano l’economia e l’energia. Come dargli torto? A furia di insistere, tutte queste macroscopiche balle, sono diventate i pilastri per condizionare le politiche economiche ed energetiche a scala globale, a spese di tutti noi, e ne possiamo discutere per ore, giorni, mesi o anni. Il corso di questa follia non cambierà.

Continua la “dissezione analitica” di Marcott et al. 2013 da parte di Steve McIntyre ed altri esperti di statistica. Allo stesso tempo continua la difesa ad oltranza delle conclusioni e delle implicazioni del paper da parte di Tamino, Nick Stokes ed altri.

Qualche giorno fa Tamino ha pubblicato un post in cui cerca di dimostrare che nella ricostruzione delle paleotemperature di Marcott et al. non possono essere “nascosti” episodi ad alta frequenza simili a quello dell’ultima parte del 20° secolo ( http://tamino.wordpress.com/2013/04/03/smearing-climate-data/ ). Nel post citato Tamino inserisce artificiosamente dei picchi di 0,9 ° C di durata pari a circa 200 anni (100 di aumento e 100 di diminuzione) nelle anomalie di temperatura desunte dai proxy. Han successivamente, introdotto una perturbazione gaussiana casuale nei tempi per tener conto dell’incertezza nella datazione dei proxy ed ha prodotto un dominio di dati casuali da cui estrarre la stima del segnale delle anomalie di temperatura. Ha ottenuto una curva simile a quella di Marcott et al. 2013 con tre “picchi” ben visibili. Ne ha dedotto che questo dimostra che, nonostante la risoluzione di trecento anni, se nel corso dell’Olocene vi fossero stati dei picchi simili a quello attuale, di essi si troverebbe traccia nella ricostruzione di Marcott et al. 2013.

Risultati molto diversi, ovviamente 🙂 , ha ottenuto il blogger Clive Best che nel suo sito ha replicato l’esperimento di Tamino con procedure statistiche diverse ottenendo tre picchi distinguibili, ma molto meno evidenti di quelli di Tamino. Introducendo altre forme di perturbazione (facendo slittare i dati di +/- 20% lungo l’asse dei tempi) i picchi tendono addirittura a sparire ( http://clivebest.com/blog/?p=4833 ) .

Chi scrive ha qualche perplessità su entrambe le metodologie in quanto esse introducono un picco di temperatura in tutti e 73 i proxy simultaneamente. La cosa mi sembra piuttosto artificiosa in quanto è molto improbabile che tutti i proxy riescano a tener conto di un riscaldamento globale di 0,9°C contemporaneamente. In altre parole, provenendo tali proxy da località differenti è difficile che riescano a registrare lo stesso aumento di temperatura: non ci riescono neanche i termometri moderni figuriamoci i proxy. Anche perché gli aumenti di temperatura che registriamo oggi sono maggiori alle alte latitudini che a quelle equatoriali per cui alcuni proxy dovrebbero essere incrementati in un modo ed altri in modo diverso. Mi sa tanto di un giochino statistico poco significativo.

Personalmente, pertanto, reputo corretto l’approccio di Marcott et al. 2013: la risoluzione della loro ricostruzione è troppo bassa perché possa conservare traccia delle variazioni di temperatura ad alta frequenza.

Molte altre critiche, comunque, vengono mosse alla metodologia statistica utilizzata da Marcott et al. 2013 per il “centraggio” dei dati: essi hanno allineato tutti i proxy a circa metà dell’olocene. In altre parole hanno ipotizzato che essi, in quel particolare periodo, registrassero le stesse anomalie di temperatura. Questa scelta potrebbe essere giustificata dal fatto che quello è il periodo in cui si sovrappongono quasi tutti i proxy utilizzati, però, determina una “innaturale” diminuzione dell’incertezza relativamente al periodo indicato ( http://climateaudit.org/2013/04/07/marcotts-dimple-a-centering-artifact/ ). Secondo i sostenitori del lavoro di Marcott et al. la possibilità di utilizzare tutti i record di dati a disposizione, giustifica la “perdita” di incertezza nel periodo in cui si sono allineati i dati, ma, secondo gli statistici puri, l’errore non è veniale, bensì sostanziale. Anche il dr. C. Lohele, esperto in paleoclimatologia, reputa poco corretto questo approccio, pur avendolo ulilizzato in un suo studio, in quanto il periodo di allineamento scelto da Marcott et al. è arbitrario e poco significativo da un punto di vista fisico. Personalmente, in questo caso, sono d’accordo con i critici di Marcott et al. in quanto esistono metodologie statistiche che consentono di analizzare serie di dati incomplete senza far ricorso a questo tipo di arrangiamenti.

Ed, infine, dobbiamo registrare i post quotidiani con cui, ormai da diversi giorni, S. McIntyre mette in evidenza il problema della divergenza tra i proxy utilizzati da Marcott et al. e quelli provenienti da aree poco distanti: utilizzando un proxy invece di un altro i risultati dello studio, soprattutto riferiti al periodo più vicino a noi, sarebbero del tutto diversi. Personalmente reputo superfluo questo accanimento visto che sembra ormai assodato che il periodo a noi più vicino è poco significativo da un punto di vista statistico.

Dopo settimane di discussione, pertanto, possiamo dire che il paper di Marcott et al. 2013 ha perso credibilità per il periodo a noi più vicino, ma conserva validità per il periodo più lontano. Per quel che ho potuto capire il periodo che stiamo vivendo NON è stato il più caldo degli ultimi 11.300 anni (almeno dai risultati della ricerca di Marcott et al. 2013). I vari comunicati stampa, però, fanno capire il contrario: mistero della comunicazione scientifica 🙂 .

Ciao, Donato.

Lo studio di Marcott et al. continua ad essere fonte di notevoli discussioni nei vari blog che si occupano di clima ed argomenti correlati. Ultimamente anche il “corpo matematico” su cui si fonda lo studio è stato posto sotto osservazione da parte degli esperti di matematica statistica.

.

Marcott et al. hanno basato il loro lavoro sull’analisi statistica dei dati desunti da carote di ghiaccio, dosaggi del rapporto Ca/Mg nei gusci di foraminiferi estratti da nuclei trivellati sul fondo del mare e via cantando, per complessive 73 serie di dati di prossimità della temperatura (dell’atmosfera e della superficie del mare). La stima delle temperature (di questo, infatti, si tratta) è stata effettuata mediante il metodo Monte Carlo. Esaminando il 68% delle serie utilizzate da Marcott et al. per ricostruire le temperature dell’ultimo periodo dell’olocene, un matematico statistico ha notato che l’incertezza insita nei valori delle anomalie di temperatura calcolati dagli autori è estremamente ridotta. Plottando i dati delle anomalie di temperatura negli ultimi 10000 anni desunti applicando il metodo Monte Carlo ad una griglia 5×5 e con un passo di 20 anni, si vede che le anomalie sono pressoché nulle per quasi tutto il periodo preso in esame e cominciano ad assumere un valore significativo solo negli ultimi 1000 anni ( http://climateaudit.org/2013/04/04/marcott-monte-carlo/ ).

La cosa, effettivamente, lascia piuttosto perplessi in quanto sembrerebbe che nel corso dell’olocene le temperature siano state praticamente costanti (a meno di differenze nell’ordine dei decimi di grado) ed abbiano cominciato a variare solo negli ultimi secoli. La spiegazione di questo “strano” andamento delle temperature, secondo l’autore del post su CA, potrebbe essere dovuta ad un errore nelle relazioni utilizzate dagli autori per ottenere il dominio di dati perturbati da cui è stato estratto il segnale mediante il metodo Monte Carlo. Secondo gli statistici che affollano CA la spiegazione del mistero dovrebbe essere ricercata nell’assenza di un parametro di perturbazione che renda non correlati i dati del dominio. Secondo Nick Stokes, invece, il termine perturbativo che gli statistici reputano mancante, in realtà, è già inserito nelle relazioni di regressione implementate da Marcott et al. per cui il metodo Monte Carlo sarebbe stato correttamente applicato in quanto i dati perturbati sarebbero non correlati.

Se l’obiezione sollevata dagli statistici dovesse essere fondata, dovrebbe essere rivisto l’intero studio e non soltanto la parte riguardante i tempi a noi più vicini che, come universalmente riconosciuto ed ammesso dagli stessi autori, è inconsistente da un punto di vista statistico.

La questione non è solo formale, ma è sostanziale in quanto investe le ipotesi che sono poste a base del metodo Monte Carlo: è assolutamente necessario che l’algoritmo che genera i dati sia tale da garantire la loro assoluta casualità, in mancanza i risultati delle elaborazioni non sarebbero affidabili. Nella fattispecie sarebbe da rivedere il 68% del dominio di dati casuali e, pertanto, il risultato finale potrebbe essere sensibilmente diverso da quello cui sono giunti Marcott et al.. La parola definitiva, però, si trova nel codice utilizzato da Marcott et al. che, a quanto sembra, non è stato reso noto.

Ciao, Donato.

Indipendentemente da considerazioni scientifiche sul lavoro abbraccio al 100% l’ultima frase del post: “a furia d insistere questi sono diventati i pilastri per condizionare le politiche e che noi ne possiamo discutere per anni il corso di questa follia non cambierà “. Questa e’ la cruda realtà e visto che repetita stufant e’ anche uno dei motivi per cui uno dopo averle dette in chiaro può salutare tutte le allegre compagnie dicendo c….scusate ‘fatti vostri…’

Molto interessante in proposito un post sul blog di Tamino. Tamino, pseudonimo con cui è noto nel mondo virtuale uno dei maggiori studiosi di climatologia e convinto assertore dell’AGW, ma dal punto di vista statistico persona estremamente competente e, secondo me, corretta, ha rivisto il lavoro di Marcott et al. applicando alle serie statistiche un metodo di elaborazione “differenziale”. Buona parte del lavoro di Marcott et al. si basa sulle medie semplici dei dati proxy analizzati. Tale metodologia, in presenza di un numero piuttosto limitato di dati e, soprattutto, in presenza di dati troncati nella parte finale, tende a “riscaldare” notevolmente la media se i dati più “freddi” si riferiscono ad anni precedenti a quelli dei dati “caldi”. Marcott et al., secondo quanto ho capito leggendo il post di Tamino, hanno commesso un errore di questo tipo: hanno applicato la media semplice a tutti i loro dati ottenendo come risultato un elevatissimo riscaldamento della parte finale del loro grafico. Sulla base della rianalisi delle serie prese in esame da Marcott et al. utilizzando il “metodo differenziale” Tamino ha potuto constatare che la parte iniziale del grafico delle temperature dell’olocene di Marcott et al. è molto robusta, mentre la parte finale (quella riferita al presente) è fortemente “riscaldata”: Tamino ha individuato un uptick, ma pari alla metà (grossomodo) di quello individuato da Marcott et al..

In poche parole tanto Tamino, quanto S. McIntyre, in modo del tutto indipendente e utilizzando metodologie statistiche differenti, sono giunti allo stesso risultato: la parte finale del grafico di Marcott et al. deve essere profondamente rivisitata. La restante parte del grafico, secondo Tamino, è statisticamente robusta.

In merito al problema della ridatazione delle carote e dei nuclei da cui sono stati desunti i dati proxy, Tamino ha analizzato i dati con la sua metodologia differenziale evidenziando qualche problema soprattutto per la parte più remota del grafico. Si tratta, però, di errori piuttosto “veniali” che non modificano più di tanto l’andamento globale del grafico delle temperature per tutto l’olocene.

Tralascio, per carità di patria (scientifica 🙂 ), i pesci in faccia che Tamino, McIntyre e le rispettive “corti” si stanno scambiando senza risparmio: è la parte della discussione che avrei preferito non leggere.

Definita l’inconsistenza statistica della parte finale del grafico di Marcott et al., restano aperti due canali di discussione: la velocità del riscaldamento dell’ultimo periodo e la sua eccezionalità.

Di essi, però, ho intenzione di parlare in un prossimo intervento: il dovere mi chiama altrove! 🙂

Ciao, Donato.

Continuando il discorso interrotto forzatamente 🙂 stamattina, vorrei spendere qualche parola in merito al riscaldamento recente ed alla sua velocità.

E’ opinione comune tra i blogger più schierati sulle posizioni dell’origine antropica del riscaldamento globale che i dati proxy poco o nulla possono aggiungere a quanto è ormai (secondo loro) “assodato”: il riscaldamento registrato dai termometri nel corso dell’ultimo secolo (il 20°) è stato senza precedenti nel senso che mai nel passato si era verificato un tale innalzamanto di temperatura in un tempo tanto breve. All’obiezione che la risoluzione temporale dei dati di Marcott et al. non consente di indagare periodi inferiori ai 120 anni, essi rispondono sostenendo che alcune delle serie di temperatura analizzate anche nel lavoro di Marcott et al., prese singolarmente, hanno una risoluzione molto più alta per cui ci consentono di affermare che la velocità con cui sono aumentate le temperature nel 20° secolo è “senza precedenti”. In altre parole questo NON si evince dal lavoro di Marcott et al., ma è un dato che risulta dalle singole serie in nostro possesso.

.

Ed ora vorrei condividere con gli altri lettori qualche considerazione personale che mi ha lasciato molto perplesso.

Lo studio di Marcott et al., dopo la correzione apportata da Tamino, dimostra che le anomalie di temperatura attuali sono inferiori a gran parte di quelle desunte dagli studi dei proxy degli ultimi 11.500 anni. In particolare anomalie maggiori delle presenti (temperature più calde) si sono verificate nel periodo compreso tra circa 10.000 anni fa e circa 3.000 anni fa (in modo quasi ininterrotto). Negli ultimi tremila anni le anomalie rilevate sono state confrontabili con quelle attuali tranne gli ultimi 600/700 anni caratterizzati da un drastico calo termico seguito da un altrettanto rapido rialzo termico nell’ultimo secolo. In altre parole, negli ultimi 10000 anni ha fatto molto più caldo di oggi. Sembra strano, ma se non ho preso lucciole per lanterne, questo si evince dal lavoro di Marcott et al. dopo le correzioni di Tamino.

Al seguente indirizzo si può trovare riscontro a quello che ho scritto.

http://tamino.wordpress.com/2013/03/22/the-tick/

p.s. Nel caso avessi preso qualche cantonata sarei grato a chi volesse metterlo in evidenza. 🙂

Ciao, Donato.

Donato, la risoluzione temporale “indagabile” con il lavoro di Marcott et al., credo sia 300 anni e non 120.

gg

PS: ogni tanto guarda la mail 😉

Stando a quanto Marcott et al. scrivono nella FAQ la

risoluzione media delle serie indagate è di circa 120 anni per cui

non si riesce a capire ciò che accade ENTRO il secolo. Che

l’intervallo assunto per effettuare la media sia di 300 anni è

pacifico, ma io mi riferivo alla risoluzione media delle serie. Ad

ogni buon conto dovrebbero esistere tre livelli di lettura delle

serie: il diagramma globale delle anomalie di temperatura tracciato

utilizzando una risoluzione di 300 anni, la risoluzione media delle

serie pari a circa 120 anni e la risoluzione di alcune delle serie

indagate che è molto alta e consentirebbe di escludere la

ricorrenza del picco attuale nei secoli passati. Le conclusioni

degli autori, pertanto, sono il frutto di una elaborazione

piuttosto complessa. Ciao, Donato.